まず結論から:2026年、AIの選び方は「性能」から「倫理と信頼」の時代へ

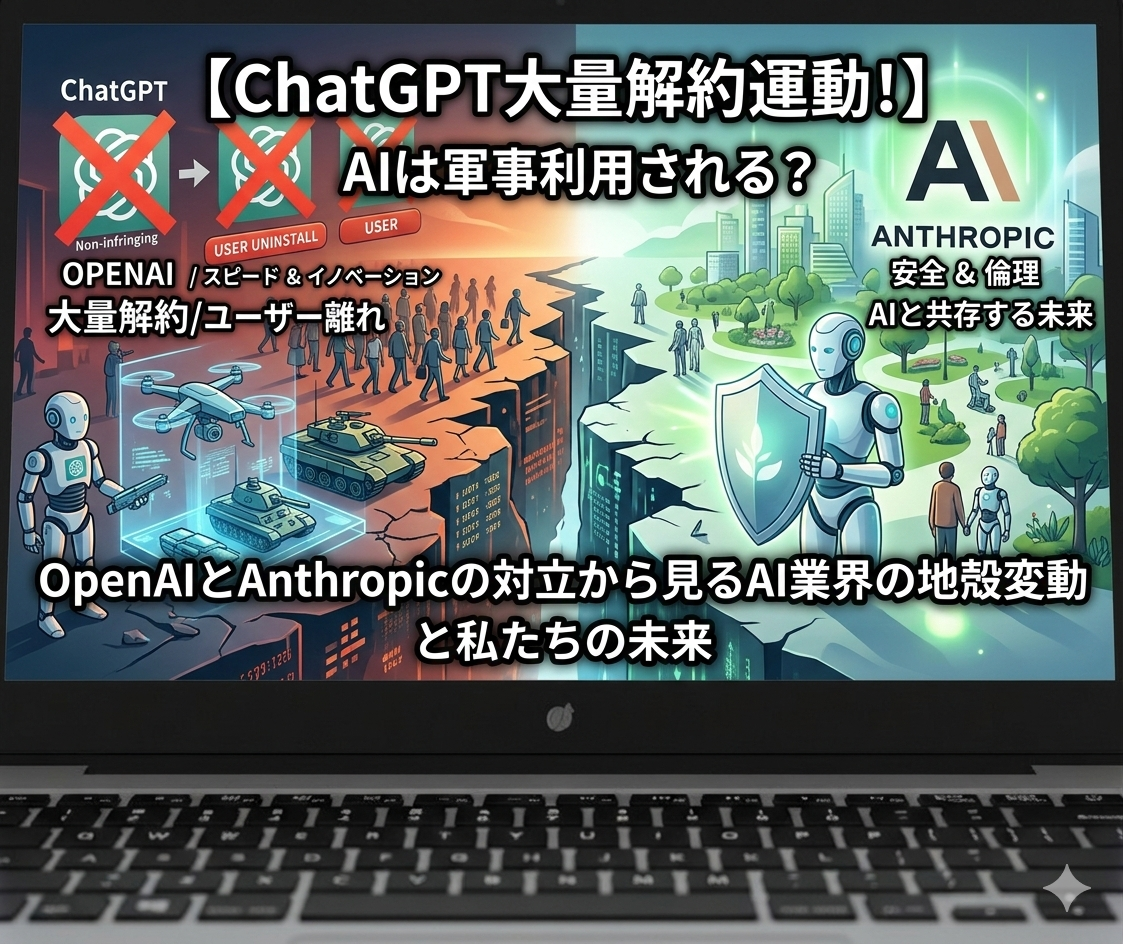

2026年現在、AI(人工知能)業界は、単なる「便利なツールの開発競争」から、国家の安全保障や企業倫理が絡む歴史的な転換点を迎えています。結論から言うと、今後の私たちが使うAIは「どのAIが一番賢いか」ではなく、「どの企業が、どのようなルールでAIを運営しているか(私たちのデータや安全をどう守るか)」で選ばれる時代に突入しました。

その最大の引き金となったのが、米国政府(戦争省※旧国防総省)によるAIの軍事利用推進と、それを巡るAnthropic(Claudeの提供元)とOpenAI(ChatGPTの提供元)の真っ向からの対立です。この対立は、私たち一般ユーザーの「AI離れ(QuitGPT運動)」や、巨大IT企業同士の覇権争いへと発展しています。本記事では、この複雑なニュースを専門用語を避けてわかりやすく解説します。

1. なぜ起きた?米国政府とAnthropic(Claude)の決裂

米国軍のAI導入プロジェクト「GenAI.mil」とは

事の発端は、米国のトランプ政権下で「戦争省(2025年に国防総省から名称変更)」が推進した「GenAI.mil」という構想です。これは、約300万人の軍関係者が最先端のAIを使えるようにする巨大プロジェクトで、「AIこそが米軍の新たな力になる」と位置づけられました。

軍はAI企業に対し、「法律の範囲内であれば、あらゆる目的(all lawful purposes)でAIを無制限に使わせること」を要求しました。つまり、「軍の作戦やターゲットの選定にAIを使う際、企業側から制限をかけないでほしい」という強い要望です。

Anthropicが引いた「絶対に譲れない一線(レッドライン)」

この軍の要求に対し、「Claude(クロード)」を開発するAnthropic社は「NO」を突きつけました。同社は創業時から、以下の2つを絶対に破ってはいけないルール(レッドライン)として掲げていたからです。

- 大量監視への利用禁止:一般市民の位置情報やウェブ履歴をAIで監視させない

- 自律型兵器への組み込み禁止:人間の判断なしに攻撃を行う兵器にAIを使わない

「たとえ政府からの圧力があっても、この倫理的な一線は超えられない」と、AnthropicのCEOダリオ・アモデイは交渉を拒否しました。例えるなら、「包丁のメーカーが、料理のためなら売るが、人を傷つける目的だとわかっている相手には絶対に売らない」と宣言したようなものです。

政府の報復:Anthropicの「排除」と現場の混乱

この拒絶に対し、米国政府は激怒。大統領は直ちに全政府機関での「Claude」の使用停止を命じ、Anthropicを国家安全保障上の「サプライチェーン・リスク(危険な取引先)」に指定するという前代未聞の強硬手段に出ました。本来、外国の敵対的な企業に使われるルールを、自国の優良企業に適用したのです。

この影響で、すでにClaudeをシステムに組み込んでいたPalantir(防衛系ソフトウェア企業)などは、莫大なコストをかけてAIを別のものに入れ替えるという大混乱に陥りました。

2. OpenAI(ChatGPT)の電撃契約と「安全」への考え方の違い

OpenAIは軍の要求を受け入れた

Anthropicが政府と決裂したまさにその週、ライバルであるOpenAI(ChatGPTの開発元)は、戦争省との間で数億ドル(数百億円)規模の契約をあっさりと結びました。

OpenAIのCEOサム・アルトマンは、Anthropicの姿勢を「過剰反応だ」と社内で一蹴。OpenAIも「自律型兵器や大量監視には使わせない」というルール自体は持っていますが、「クラウド上でのみ動かす」「専門のエンジニアが監視する」といった技術的な仕組みを設けることで、政府の「すべての合法的な目的」という曖昧な条件を丸呑みしたのです。

専門家が指摘する「合法的な大量監視」の抜け穴

しかし、専門家たちはOpenAIの対応を強く批判しています。なぜなら、米国ではテロ対策などの名目であれば、一般人の膨大なデータを収集することが「合法的な情報収集」とみなされる法律(FISAなど)があるからです。政府が「これは監視ではなく合法的な調査だ」と言い張れば、OpenAIのルールは事実上無効になってしまう危険性があります。

両社のCEO:正反対の経営哲学

この違いは、トップ2人の「AIの安全性」に対する考え方(哲学)の違いから来ています。

- Anthropic(アモデイCEO):「100%安全だと確証が持てない限り、危険な場所には出さない」(石橋を叩いて渡る慎重派)

- OpenAI(アルトマンCEO):「まずは現場に出してみて、問題が起きたら走りながら直す」(実用重視のシリコンバレー的思考)

3. 消費者の反乱!「QuitGPT」運動と大移動

「ChatGPTをやめよう」150万人が抗議

OpenAIが軍と契約を結んだというニュースは、一般ユーザーに大ショックを与えました。「自分たちのデータが戦争に使われるかもしれない」「軍と癒着した企業は信用できない」とSNSで炎上し、「QuitGPT(ChatGPTをやめよう)」という不買運動が勃発したのです。

わずか48時間で150万人が解約を宣言し、米国でのChatGPTアプリのアンインストール率は通常の約3倍(前日比295%増)に跳ね上がりました。

ClaudeとGoogle Geminiへの歴史的大移動

ChatGPTを辞めたユーザーたちがどこへ行ったかというと、皮肉なことに、軍の要求を蹴って政府から排除されたAnthropicの「Claude」でした。「魂を売らなかった企業」として称賛され、ClaudeはAppleのApp StoreでChatGPTを抜き、見事1位を獲得しました。

さらに、この混乱の中で漁夫の利を得たのがGoogleの「Gemini」です。Geminiは月間アクティブユーザーを6.5億人にまで伸ばし、単なるチャットだけでなく、検索や業務の強力なアシスタントとして急成長しています。

4. IT企業内部の亀裂と、巨大な「インフラ支配」の行方

従業員からの「ノー」:GoogleとOpenAIでの抗議活動

影響は消費者だけにとどまりません。GoogleやOpenAIの内部でも、「自分たちが作った技術を人殺しの道具にしないでくれ」と、数百人の天才エンジニアたちが経営陣に抗議の署名を提出しました。優秀な人材の離反は、AI企業にとって致命傷になりかねません。

Amazonの「全方位外交」:勝者は誰か?

表舞台でAI企業が争う中、裏で巨大な利益を握ろうとしているのがAmazon(AWS)です。Amazonは、軍と契約したOpenAIに最大500億ドル(約7.5兆円)という桁違いの投資を発表する一方で、軍から排除されたAnthropicにも40億ドル以上を投資しています。

つまり、「AIの倫理観に関わらず、どちらが勝ってもAmazonのクラウド基盤とAIチップが使われる」という、カジノの胴元のような最強の立ち位置(全方位外交)を築き上げたのです。

5. 今後の予測:2026年以降のAIはどうなる?

この一連の騒動を経て、AI業界は今後3つの大きな変化を迎えると予測されています。

- 市場の完全な二極化:

軍や政府と密接に結びつく「OpenAI(ChatGPT)」と、プライバシーとコンプライアンスを最優先し、銀行や大企業からの絶大な信頼を集める「Anthropic(Claude)」という、全く性質の違う2つの陣営にハッキリと分かれます。 - 「おしゃべり」から「自律型エージェント」へ:

AIは私たちが質問して答えるだけのチャットボットから、複数のAIが協力して人間の代わりに複雑な仕事を最後までやり遂げる「エージェントAI」へと進化します。 - AIの「鎖国」が始まる:

米国が自国企業(Anthropic)でさえ強制的に排除したのを見た世界各国は、「他国のAIに頼るのは危険すぎる」と悟りました。今後は、自国専用のAI(ソブリンAI)を開発する「技術ナショナリズム」が加速し、世界共通のAIサービスという概念は崩れていくでしょう。

まとめ:私たちが迫られる「選択」

これまで私たちは、「文章が上手いから」「計算が早いから」という理由だけでAIを選んできました。しかし2026年以降は、「そのAIの裏側にどんな国家の意図があるのか」「私たちのデータをどう扱う哲学を持った企業なのか」を見極める必要があります。

便利なテクノロジーの裏側にある現実を知り、自分自身や自社のビジネスを預けるにふさわしいパートナー(AI)を戦略的に選ぶ。それが、これからの時代を生き抜くために私たち全員に求められる新しいリテラシーです。

この記事はいかがでしたか?AIツールの乗り換えを検討中の方や、自社のセキュリティ基準を見直したい方は、ぜひ今後の動向もチェックしてみてくださいね!

参考リンク

- Fact Sheet: President Donald J. Trump Restores the United States Department of War

- Restoring the United States Department of War – The White House

- Secretary of War | U.S. Department of War

- OpenAI to work with Pentagon after Anthropic dropped by Trump over company’s ethics concerns

- ‘Radical Left, woke company’: Trump asks officials to stop using Anthropic AI tech or face ‘full power of Presidency’

- A Timeline of the Anthropic-Pentagon Dispute | TechPolicy.Press

- Experts raise questions and concerns about Pentagon’s threat to blacklist Anthropic amid AI spat | DefenseScoop

- Anthropic says it ‘cannot in good conscience’ allow Pentagon to remove AI checks

- What Hegseth’s “Supply Chain Risk” Designation of Anthropic Does …

- Don’t bet that the Pentagon – or Anthropic – is acting in the public …

- OpenAI’s Pentagon AI Deal: What the Contract Allows and How It Differs From Anthropic | Built In – Tech Jobs Personalized

- OpenAI CEO Sam Altman finalises deal with US government amid Trump’s war with Anthropic

- Two Visions for Navigating AI’s Adolescence: Altman and Amodei on the Rite of Passage Ahead – Serious Insights

- What Sam Altman and Dario Amodei Disagree About (And Why It Matters for You)

- ‘No ethics at all’: the ‘cancel ChatGPT’ trend is growing after OpenAI signs a deal with the US military | TechRadar

- CancelChatGPT: Users Are Mass-Migrating to Claude After OpenAI’s Pentagon Deal

- Katy Perry subscribes to Claude as calls for ChatGPT boycott grow – Cybernews

- AI Chatbot Market Share 2026: Similarweb Analysis | ChatGPT vs Gemini – Vertu

- ChatGPT will be available to 3 million military users on GenAI.mil

- The War Department Unleashes AI on New GenAI.mil Platform …

- Pentagon Selects Google Gemini for GenAI.mil Platform – ExecutiveGov

- Pentagon rolls out GenAI platform to all personnel, using Google’s Gemini

- Pentagon, Musk’s xAI reach agreement to use Grok in classified systems: Report

- Anthropic CEO defends AI ‘red lines’ after U.S. government ban (ANTHRO:Private)

- Anthropic rejects Pentagon terms for lethal use of its chatbot Claude

- Sam Altman says OpenAI shares Anthropic’s red lines in Pentagon fight – LessWrong

- OpenAI is changing its contract with Pentagon; CEO Sam Altman says: I would rather go to jail than

- Agencies begin to shed Anthropic contracts following Trump’s directive

- US agencies switching to OpenAI, Google amid Anthropic phaseout – Seeking Alpha

- What the Impasse Between the Defense Department and Anthropic Implies About Mass Surveillance and Autonomous Weapons – Verdict

- Pentagon’s war on Anthropic based on ‘dubious’ legal thinking and ideology—not real risk, sources say

- Pentagon’s Anthropic Designation Won’t Survive First Contact with Legal System

- Statement on the comments from Secretary of War Pete Hegseth – Anthropic

- Palantir faces challenge to remove Anthropic from Pentagon’s AI software – Investing.com

- Read memo that Sam Altman sent to employees hours before OpenAI signed deal with Pentagon and said that actually meant: Anthropic is ‘overreacting’

- Our agreement with the Department of War | OpenAI

- ‘Cancel ChatGPT’: Sam Altman under fire for Pentagon deal as Anthropic draws red line on mass surveillance

- Defense tech enters a new era: the case of Anthropic and the DOD – Nextgov/FCW

- What rights do AI companies have in government contracts? – Nextgov/FCW

- OpenAI Claims Safety ‘Red Lines’ in Pentagon Deal—But Users Aren’t Buying It

- Pentagon’s AI contracts spur autonomous weapons, surveillance debate

- OpenAI’s Sam Altman vs Anthropic’s Dario Amodei: Rivalry on full display at India AI Impact Summit 2026 – Technology News | The Financial Express

- OpenAI Vs. Anthropic Statistics By Trends, Insights And Facts 2026 – ElectroIQ

- War over AI in war: Why many are cancelling ChatGPT subscription – The Times of India

- The Day “QuitGPT” Launched (And Google Overtook OpenAI While Anthropic Banned Ads) | by Baozilla, Let’s go! | Feb, 2026 | Medium

- ‘Don’t Support Bootlickers’: ChatGPT Subscribers Vow Mass Cancellations After Pentagon Deal | Common Dreams

- OpenAI loses 1.5 million subscribers in less than 48 hours after CEO Sam Altman says yes to the deal that Anthropic rejected – The Times of India

- QuitGPT Claims 1.5 Million Have Taken Some Action – YouTube

- 1.5 Million Users Leave ChatGPT – Reddit

- Anthropic’s Claude Hits No. 1 in the App Store as Users Drop Chat GPT over Recent News

- ChatGPT Uninstalls Spike, Claude Downloads Soar After Defense Deal – News and Statistics

- ChatGPT uninstalls surge 295% in US as Anthropic’s Claude AI gains after OpenAI’s Department of War partnership

- Anthropic AI Model Claude Replaces ChatGPT as Top on Apple App Store

- One AI app has taken over the no.1 spot on App Store as users quietly ditch ChatGPT

- Anthropic’s Super Bowl ad pays off: How Claude users surge 11% and enters Apple App Store’s top 10 after taking aim at OpenAI – The Economic Times

- Claude has overtaken ChatGPT in the Apple App Store : r/ClaudeAI – Reddit

- How to Switch From ChatGPT to Claude — and Delete Your Account for Good

- Top Generative AI Chatbots by Market Share – March 2026 – First Page Sage

- ChatGPT Reaches 900 Million Weekly Active Users: What Every Business and Marketer Must Know in 2026 | ALM Corp

- Google Gemini Stats Feb 2026 – Market Share, Users and More. – fatjoe.

- Google AI Researchers Seek Military Restrictions Amid Pentagon Controversy

- Google AI Workers Demand Limits on Military Use After Anthropic Dispute – New York Today

- Google, OpenAI Workers Demand Military AI Limits Amid Iran Crisis

- Filings: How Amazon’s $50B OpenAI deal actually works, and what …

- Amazons 50-Milliarden-Wette auf OpenAI: Frontalangriff auf Nvidia und bitterer Rückschlag für Microsoft

- OpenAI announces $110bn funding round that would value firm at $840bn

- Amazon Commits $50 Billion to OpenAI in Strategic AI Partnership

- OpenAI gets $110 billion in funding from a trio of tech powerhouses, led by Amazon

- Anthropic revenue, valuation & funding – Sacra

- Predictions 2026: AI Moves From Hype To Hard Hat Work – Forrester

- Gartner Says Worldwide AI Spending Will Total $2.5 Trillion in 2026

- Forrester’s 2026 Technology & Security Predictions: As AI’s Hype Fades, Enterprises Will Defer 25% of Planned AI Spend to 2027 – Investor Relations

- AI Agent Adoption 2026: What the Data Shows | Gartner, IDC – Joget

- Stanford AI Experts Predict What Will Happen in 2026

- Predictions 2026: Tech Nationalism Will Reshape Public-Sector AI, Security, And Procurement – Forrester